Meta опублікувала результати тесту, згідно з якими соцмережі не руйнують демократію і не впливають на поляризацію думок. Чому це неправда? Колонка Сергія Жданова

Раз на тиждень філософ технологій та автор телеграм-каналу «Чорт ногу сломит» Сергій Жданов пише колонку про те, як технології змінюють реальність. Приводом для нового матеріалу стала публікація даних дослідження впливу соцмереж на політичні вподобання, на демократію США та поляризацію думок, які охарактеризували період 2010–2020-х, — за результатами, це не так. Чому це не зовсім правда, чому Facebook «корпоративно газлайтить» користувачів і до чого тут убитий альбатрос?

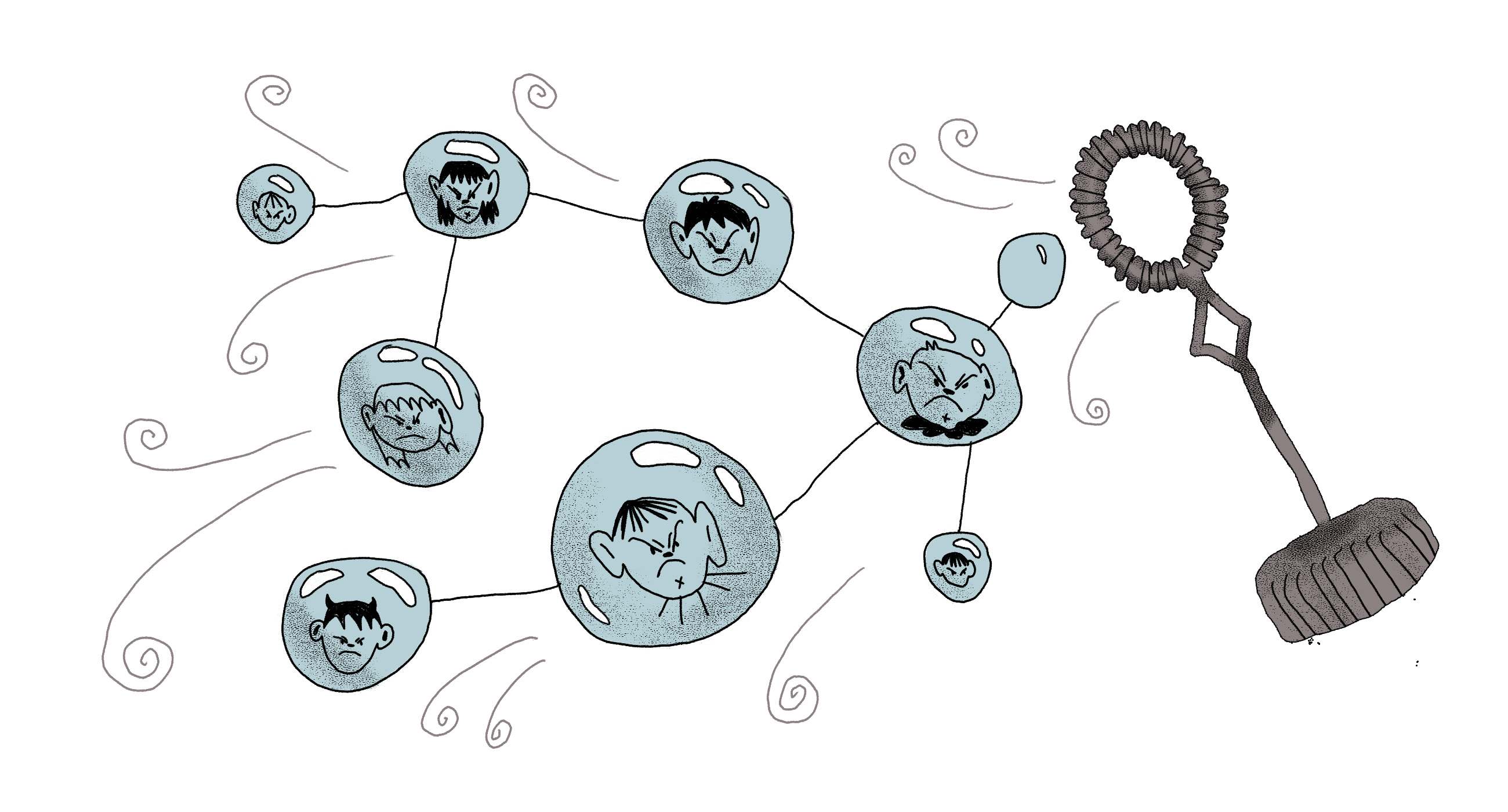

Нещодавно група американських учених опублікувала результати досліджень впливу алгоритмів Facebook та Instagram на політичні вподобання користувачів. Дослідження відбувалися 2020 року на тлі виборів президента США й тривали три місяці. Учасникам вимикали алгоритмічну стрічку, в якій ШІ вибирає найрелевантніший для них контент, і замінювали хронологічною стрічкою, в якій просто відображалися найсвіжіші пости. За словами вчених, вони спробували перевірити вже усталений набір думок, з урахуванням яких «алгоритми створюють політичні “бульбашки фільтрів”, заохочують поляризацію, посилюють соціальну нерівність і сприяють поширенню дезінформації».

Під час дослідження з’ясувалося:

— консерватори більше за лібералів схильні до того, щоб залишатися у своїй інформаційній бульбашці й не виходити за її межі, а також поширюють фейкові політичні новини значно частіше, ніж їхні візаві;

— алгоритмічна стрічка робить Facebook удвічі цікавішим, оскільки користувачі, яким відключили алгоритми розумної стрічки, проводили на платформі вдвічі менше часу, ніж користувачі з увімкненими ШІ-стрічками;

— відключення алгоритмічної стрічки та подання контенту в хронологічному порядку зменшили кількість сварок і скандалів у стрічках більш ніж на 40%.

Однак головне запитання — чи змінюються політичні вподобання користувачів, якщо вимкнути їм розумну стрічку, — отримало незадовільну відповідь: «Хоча тепер ми достеменно знаємо, наскільки алгоритми впливають на поведінку користувачів на самих платформах, ми з’ясували, що зміна алгоритмів розумних стрічок навіть на кілька місяців не змінює політичних поглядів людей. І ми не розуміємо чому. Може, тому, що алгоритми змінили на недостатньо довгий проміжок часу, або тому, що алгоритми цих платформ до цього працювали кілька десятиліть, або тому, що хоча Facebook та Instagram — впливові джерела інформації, вони не єдині джерела людей».

Ілюстрація: Катерина Круглик / Заборона

Отже, тимчасове розсіювання бульбашки фільтрів (відключення алгоритмічної стрічки) не здатне вивести людину з її інформаційного поля та змінити її політичні погляди. При цьому з інших досліджень ми знаємо, що алгоритми соціальних мереж радикалізують і поляризують людей та посилюють психологічні труднощі в підлітків.

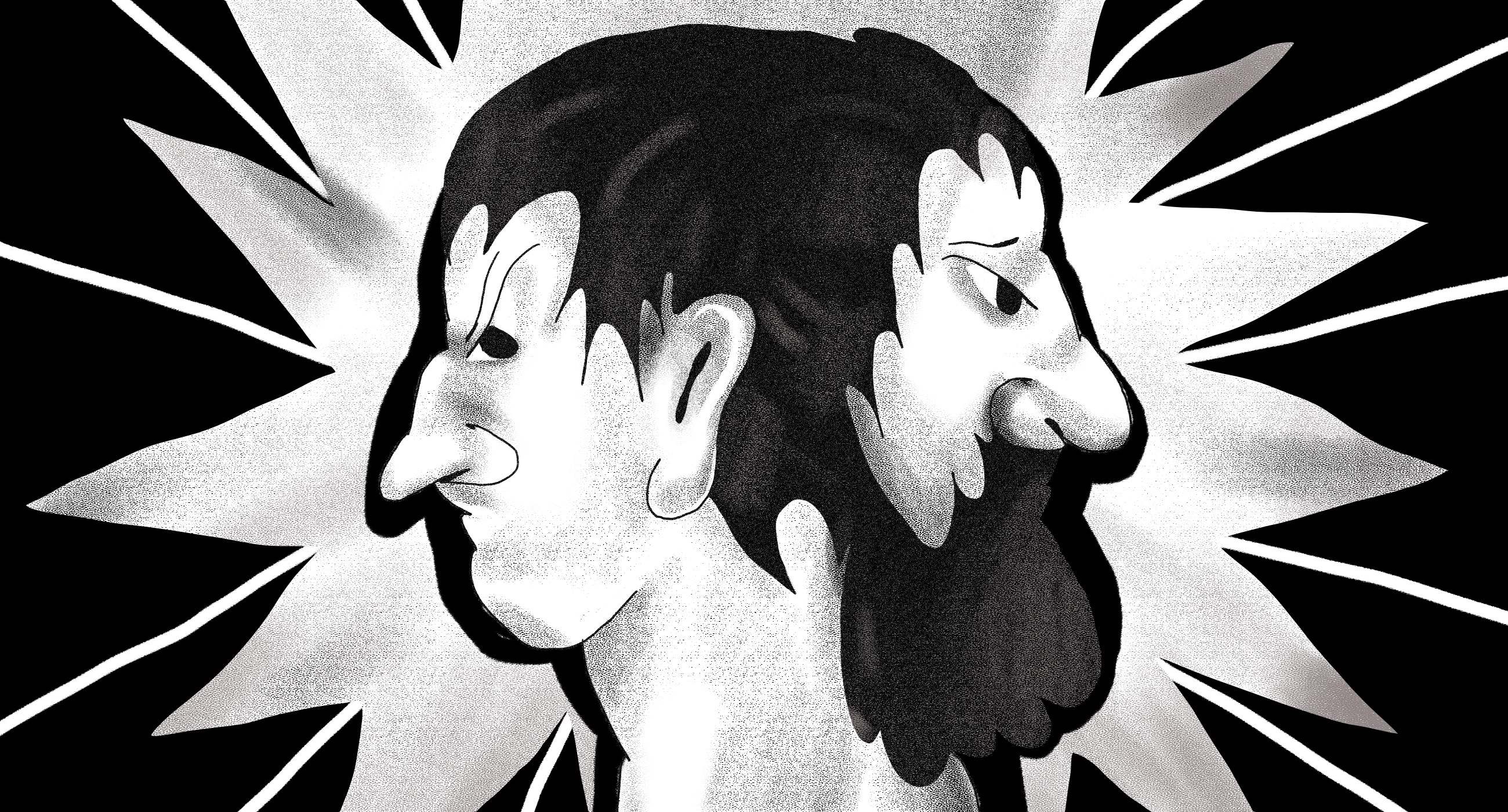

Але нещодавній тест соцмереж на американську демократію проводили під егідою корпорації Meta, яка і дозволила вченим маніпулювати алгоритмами розумної стрічки Facebook та Instagram. Але навіщо це дослідження потрібне корпорації? Meta краще за всіх відомо, як її алгоритми впливають на майже 4 мільярди користувачів її соцмереж і месенджерів. Учені зсередини корпорації роками проводять дослідження, проте ніколи не поспішають ділитися одержаними результатами з публікою, оскільки майже щоразу, коли вони розповідали, як працюють алгоритми стрічки та як це позначається на користувачах, вибухав гучний скандал (і навіть влаштовували публічні допити Цукерберга в Сенаті), заклики видалятися із соцмереж тощо. У результаті люди роками зазнавали алгоритмічного впливу розумних стрічок, воліючи не замислюватися про те, що це насправді означає і до чого може призвести.

Це дослідження вийшло саме зараз, тому що в США розпочалися передвиборчі президентські перегони. І це автоматично означає, що від табору критиків Цукерберга знову зазвучать закиди, що Meta руйнує демократію та штовхає країну в безодню громадянського конфлікту. Ці звинувачення постійні починаючи з 2016 року, коли багато в чому саме завдяки алгоритмам Facebook Дональд Трамп став 45-м президентом США. Трамп був украй вдячний Цукербергу, публічно лестив і навіть називав його перспективним кандидатом у президенти. Але оскільки проти Трампа «воював» майже весь політичний істеблішмент США, для Цукерберга ця «дружба» обернулася низкою судових розглядів, багатомільярдними штрафами та тимчасовою втратою частини вартості компанії. До виборів 2020 року Цукерберг зробив усе, щоб дистанціюватися від Трампа й не дозволити йому повторно експлуатувати алгоритми Meta, а в критичний момент виборів і взагалі забанив його обліковий запис.

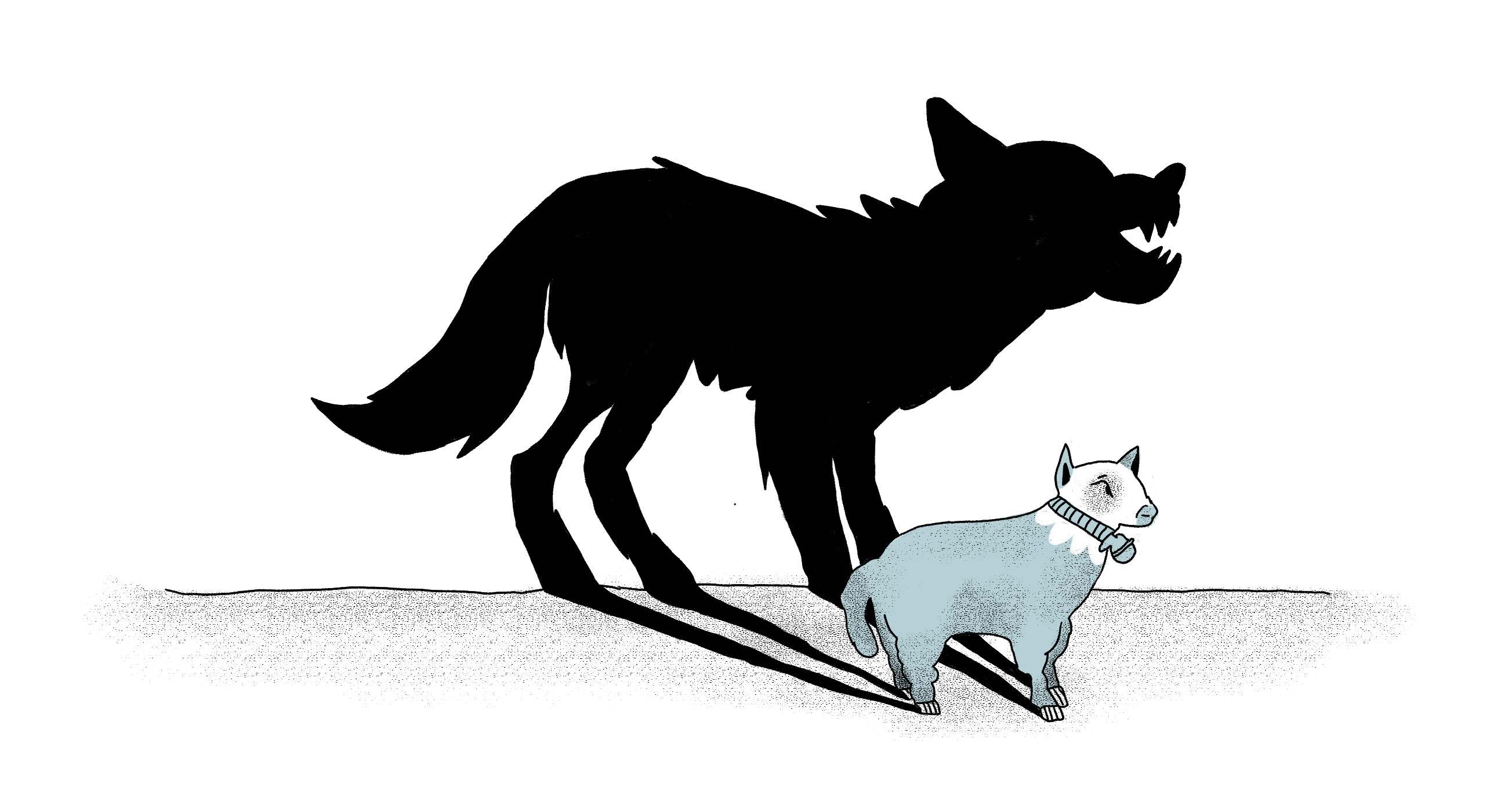

Зараз на носі вибори-2024, і тепер Цукерберг не тільки дуже далекий від Трампа, а й намагається довести всьому світу, що ШІ його корпорації — не така вже й зла та впливова штука, як усім здавалося останні сім років: звідси і дослідження, і особливо висновки вчених, які заявляють, що, можливо, алгоритми Meta зовсім не впливають на політичну орієнтацію. Звичайно, соцмережі — не єдине джерело інформації про політику, та й сама соцмережа не продукує жодної політичної інформації, а просто збирає чужу і за допомогою алгоритмів надає до них доступ. Та все-таки 220 мільйонів американців (⅔ населення країни) зареєстровані у Facebook, майже 70% з них користуються соцмережею щонайменше раз на день, і приблизно третина дорослих американців регулярно читають новини саме тут. Незалежно від політичних уподобань користувачів алгоритми Meta формують споживання, поширення та обговорення політики.

Ілюстрація: Катерина Круглик / Заборона

Те, що три місяці експерименту з відключенням алгоритмів ніяк не вплинули на політичні погляди користувачів, — цілком очевидна закономірність, якщо враховувати, що поляризація між республіканцями й демократами сягнула найвищого рівня за останні 50 років. У такої поляризації, звичайно, не може бути однієї причини, однак у середовищі фахівців — від учених і розробників до політиків — майже ні в кого не викликає сумніву ключова роль соцмереж і конкретно Facebook у розпалюванні політичного сектантства. Все це через алгоритми розумної стрічки, які, як з’ясувало новітнє дослідження, роблять соцмережу вдвічі цікавішою.

У Facebook не просто знають про таку думку, але навіть пишуть корпоративні методички, за якими співробітники компанії мають виправдовуватися від звинувачень в алгоритмічній шкоді. Одна з таких методичок за 2021 рік називається «Що ми знаємо про поляризацію»: у ній топменеджери компанії намагаються спростувати «аргумент, що Facebook загострює соціальні проблеми й поміщає цілі суспільства в контекст, в якому вони не можуть вірити одне одному, не можуть знайти спільну мову, не можуть обговорювати проблеми та не можуть зійтися на загальному уявленні про реальність». Автори методички називають цю думку «публічним наративом-альбатросом», що відсилає до вірша англійського поета Семюела Колріджа, в якому моряк знічев’я вбив альбатроса, а потім змушений носити труп птиці на своїй шиї як покарання. Навіть більше, хоча Meta заперечує, що вона винна в поляризації, в тій же методиці ідеться, що поляризація — це не так уже й погано, а іноді навіть корисно для демократії. Колишній співробітник Facebook, який вивчав проблему поляризації зсередини корпорації, дуже влучно охарактеризував цю методичку як «корпоративний газлайтинг, замаскований під дослідження».

А чи можна влаштувати все інакше? Так, якщо Meta демократизує алгоритми: дозволить користувачам краще в них розібратися, дасть кожному інструменти для індивідуального налаштування та навчить людей спрямовувати ШІ на служіння їхнім власним інтересам. До інтересів більшості не належить утрата контролю над власною увагою чи розпалювання гніву й ненависті до себе та інших.