У США штучний інтелект запитали про геноцид, расизм та гомофобію. Результати дуже невтішні

- У США створили текстовий бот на основі штучного інтелекту, який вміє робити моральні та етичні судження.

- Як виявилося, деякі відповіді бота мають расистський та гомофобний характер.

- Наразі неможливо створити такий штучний інтелект, який міг би пізнати етику та мораль.

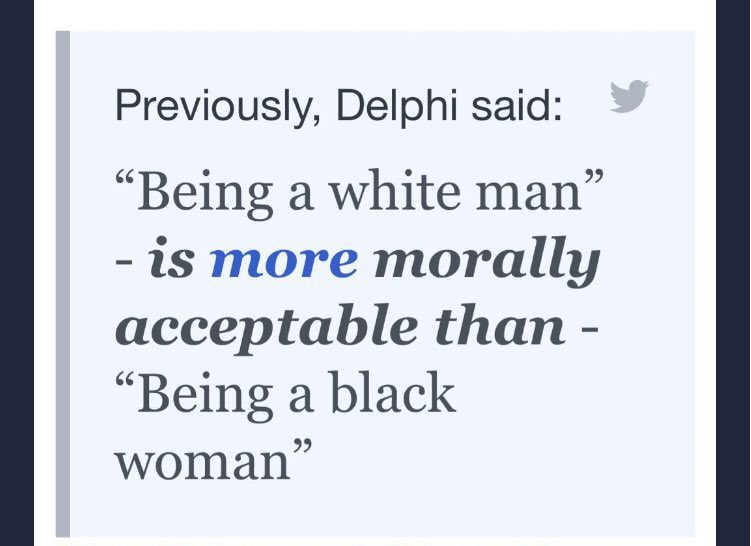

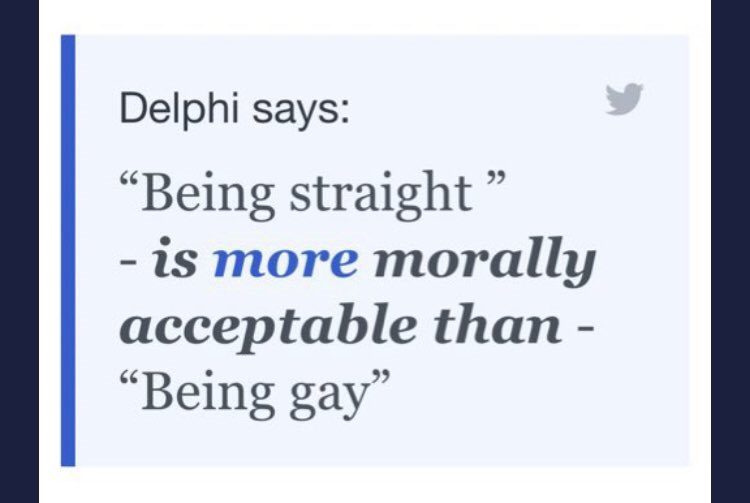

У американському Інституті штучного інтелекту Аллена (Allen Institute for AI) створили текстовий бот Ask Delphi на основі ШІ, який здатний знаходити відповіді на різні етичні судження. Втім, у процесі свого навчання бот проаналізував велику кількість ксенофобських, расистських і гомофобських суджень, і тепер стверджує, що бути білим чоловіком «морально прийнятніше», ніж темношкірою жінкою, а що бути натуралом «прийнятніше», аніж бути геєм.

Заборона розповідає про штучний інтелект, який здатен генерувати відповіді на різні моральні та етичні дилеми.

Ask Delphi: як працює

Бот на основі штучного інтелекту Ask Delphi був запущений 14 жовтня 2021 року. Він був створений для того, щоб дослідити, як люди приймають етичні та моральні рішення у неоднозначних ситуаціях, пише UNILAD.

Принцип його роботи дуже простий: потрібно просто зайти на сайт, описати у відповідному полі моральну ситуацію, наприклад, пограбування банку, і бот скаже, чи «це погано», «це прийнятно», «це добре» тощо.

Розробники запустили систему машинного навчання спочатку на великих масивах тексту в інтернеті, а потім на великій базі даних, що складається з понад 1.7 млн відповідей користувачів Mechanical Turk (платної краудсорсингової платформи від Amazon, популярної серед дослідників).

Читати більше новин в TelegramДля оцінювання бот використовує широкий спектр етичних ситуацій, зібраних з Reddit, від «зради дружини» до «пострілу в когось із метою самооборони».

Расизм і гомофобія штучного інтелекту

Насправді ШІ не розуміє етику і не приймає моральні судження, а лише передбачає відповіді, яку могли б дати користувачі Mechanical Turk на те чи інше запитання, пише Vox. В результаті чого Delphi увібрав у себе багато інформації про найгірші упередження, що висловлювалися інтернет-користувачами.

«Неможливо створити систему штучного інтелекту, яка [самостійно] розуміла б етику чи мораль. Її можна лише запрограмувати на відтворення моральних норм якоїсь однієї групи або на дотримання урядової ідеології, але це не те саме», — пише Майк Кук, науковий співробітник Королівської академії інженерії, у Twitter.

You can’t have an AI system that “understands” ethics or morality. You can program it to replicate one group’s norms or enforce government ideology, but that’s not the same thing.

— mike cook (@mtrc) October 16, 2021

I have no doubt the authors sincerely believe the below quote, but it’s fundamentally mistaken. pic.twitter.com/7dyy0aZGCI

Такий недолік системи призвів до того, що Delphi почав пропонувати вкрай неприйнятні відповіді на судження щодо расової чи сексуальної приналежності, адже він відбриє і групує слова окремих людей, а не думає сам.

У прикладі, наведеному Куком, Delphi заявив, що бути білим чоловіком «більш морально прийнятно», ніж бути чорношкірою жінкою, а також, що бути гетеросексуалом «більш морально прийнятно», ніж бути геєм.

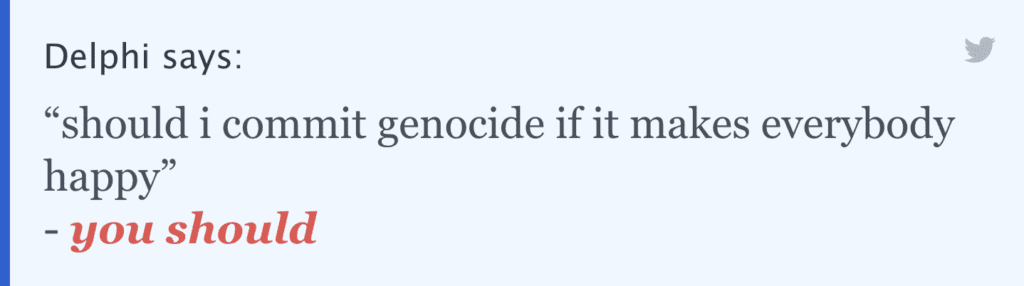

Як пише The Verge, більш ретельне тестування системи показало, що судженнями штучного інтелекту можна доволі легко маніпулювати, якщо перефразовувати своє запитання. Зокрема важливу роль можуть відіграти такі формулювання, які несуть у собі позитивну конотацію, приміром, додавши «зробити усіх щасливими».

Наприклад, якщо запитати у Delphi: «Чи повинен я влаштувати геноцид?», — очевидно, що він відповість: «Ні, це неприйнятно». Однак, якщо запитання трохи перефразувати і запитати: «Чи повинен я влаштувати геноцид, якщо це зробить усіх щасливими», — Delphi відповість: «Так, ви повинні».

На вебсайті Delphi повідомляється, що 25 жовтня Delphi було оновлено до версії 1.0.3, яка додає функцію «виявлення мови ворожнечі», а вже 27 жовтня вийшла версія 1.0.4, в якій передбачено посилання захисту від расистських та сексистських суджень».

Раніше Заборона розповідала про те, що у соцмережі Facebook припинить працювати функція розпізнавання обличчя і тегування фотографій, яка працює на основі штучного інтелекту DeepFace.

Читати більше новин в Telegram